Die neuen Barrierefreiheitsfunktionen von Apple

Apple hat neue Funktionen für iOS und iPadOS angekündigt, die darauf abzielen, Geräte für alle zugänglicher zu machen, auch für Menschen mit Behinderungen. Ein Hauptelement der neuen Feature-Liste ist Eye Tracking. Wie der Name schon sagt, ermöglicht dies einem iPhone oder iPad, die Augen eines Benutzers für Eingaben zu verfolgen.

Indem sie den Fokus ihres Blicks verschieben, können Benutzer durch Apps navigieren und mit ihnen interagieren. Laut Apple ermöglicht die Funktion Benutzern, Funktionen wie das Tippen auf Elemente, das Scrollen und andere Gesten „nur mit ihren Augen“ nachzuahmen. Obwohl eine ähnliche Funktion schon seit einiger Zeit auf anderen Geräten verfügbar ist, erforderte sie zusätzliche Hardware und spezielle Software.

Eye Tracking ist nicht App-spezifisch und erfordert keine zusätzliche Hardware. Kompatible Geräte erreichen dies laut Apple durch die Verwendung der Frontkamera und „maschinelles Lernen auf dem Gerät“. Das Unternehmen gibt an, dass alle in dieser Funktion verwendeten Daten auf dem Gerät gespeichert und nicht weitergegeben werden. Diese Funktion kann sich für Menschen mit eingeschränkter Mobilität als äußerst nützlich erweisen und ihnen die Verwendung ihres Geräts erleichtern.

Music Haptics lässt ein iPhone synchron mit Audio vibrieren, das über die Musik-App von Apple abgespielt wird. Laut Apple bietet dies „gehörlosen oder schwerhörigen Nutzern eine neue Möglichkeit, Musik auf dem iPhone zu erleben“. Während die Funktion derzeit für die Musik-App von Apple entwickelt wird, wird das Unternehmen eine API veröffentlichen, damit Entwickler die Funktion in ihren Apps implementieren können.

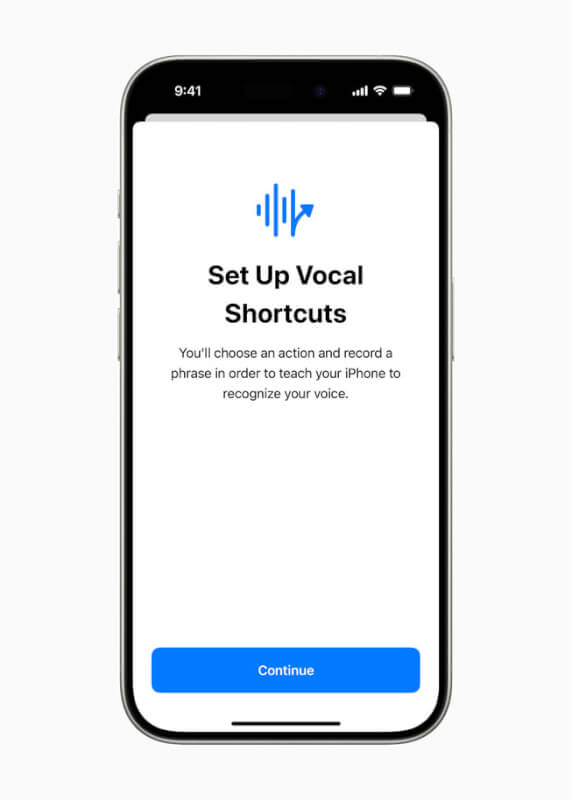

Sprachverknüpfungen ermöglichen es Benutzern, Sprachbefehle anzupassen. Mit dieser Funktion kann Siri nicht-traditionelle verbale Signale oder Geräusche verstehen, um Verknüpfungen und andere Aufgaben auszuführen. In ähnlicher Weise ermöglicht „Atypical Speech Listening“ dem Gerät, zu lernen, wie ein Benutzer spricht, was bedeutet, dass Menschen mit Sprachbehinderungen ihr Telefon trainieren können, um sie besser zu verstehen.

Vehicle Motion Cues füllt den Bildschirm des Geräts mit sich bewegenden Punkten, um den Benutzer visuell auf Bewegungen in der Umgebung aufmerksam zu machen, z. B. beim Autofahren. Die Funktion nutzt die Sensoren des iPhones oder iPads, um die Punkte synchron mit der Bewegung zu animieren, entweder automatisch oder über eine Schaltfläche, die im Kontrollzentrum platziert werden kann. CarPlay erhält außerdem einige neue Barrierefreiheitsfunktionen, darunter Sprachsteuerung,

Farbfilter für Farbenblinde und Geräuscherkennung, die gehörlosen oder schwerhörigen Fahrern helfen können, Umgebungsgeräusche wie Sirenen oder Alarme zu erkennen. Es gibt auch Aktualisierungen bestehender Barrierefreiheitsfunktionen, über die Sie auf der News-Seite von Apple lesen können.

Aktuelle smartphone

-

18 Febsmartphone

-

07 Jansmartphone

OnePlus 13

-

03 Dezsmartphone

OnePlus 13 wird im Januar 2025 weltweit eingeführt

-

25 Oktsmartphone

OnePlus bringt OxygenOS 15 auf den Markt

-

17 Oktsmartphone

OxygenOS 15 geht am 24. Oktober live

-

20 Sepsmartphone

Apple kann gezwungen werden, Siri zu öffnen

-

10 Sepsmartphone

Der A18 Pro-Chip im iPhone 16 Pro ist 15 Prozent s

-

10 Sepsmartphone

Apples Event brachte viele Neuigkeiten.